Могут ли поисковые системы обнаруживать контент ИИ?

Появление инструментов искусственного интеллекта в прошлом году сильно повлияло на интернет-маркетологов, особенно на тех, кто занимается поисковой оптимизацией.

Учитывая, что создание контента требует много времени и средств, маркетологи обратились за помощью к ИИ, но результаты оказались неоднозначными

Несмотря на этические проблемы, постоянно возникает один вопрос: «Могут ли поисковые системы обнаруживать мой контент с искусственным интеллектом?»

Этот вопрос считается особенно важным, поскольку ответ «нет» делает недействительными многие другие вопросы о том, следует ли и как следует использовать ИИ.

Долгая история машинно-генерируемого контента

Несмотря на беспрецедентную частоту создания контента с помощью машин или с его помощью, это не совсем ново и не всегда отрицательно.

Для новостных веб-сайтов важно сначала сообщать новости, и они уже давно используют данные из различных источников, таких как фондовые рынки и сейсмометры, чтобы ускорить создание контента.

Например, фактически правильно опубликовать статью о роботах, в которой говорится:

«Землетрясение [магнитуды] было обнаружено в [место, город] в [время]/[дата] сегодня утром, первое землетрясение с [дата последнего события]. Другие новости следуют».

Подобные обновления также полезны для конечного читателя, которому необходимо получить эту информацию как можно быстрее.

С другой стороны, мы видели множество "черных" реализаций машинно-генерируемого контента.

Компания Google уже много лет осуждает использование цепей Маркова для создания текста и преобразования контента с минимальными усилиями под лозунгом "автоматически генерируемые страницы, не дающие никакой дополнительной ценности".

Что особенно интересно и в основном вызывает путаницу или серую зону для некоторых, так это значение фразы «отсутствие добавленной стоимости».

Как LLM могут повысить ценность?

Популярность ИИ-контента резко возросла из-за того, что внимание привлекли большие языковые модели GPTx (LLM) и доработанный чат-бот ChatGPT с искусственным интеллектом, который улучшил диалоговое взаимодействие.

Не вдаваясь в технические детали, следует учесть несколько важных моментов, касающихся этих инструментов:

Сгенерированный текст основан на распределении вероятностей

Например, если вы пишете: «Быть SEO-специалистом весело, потому что…», LLM просматривает все токены и пытается вычислить следующее наиболее вероятное слово на основе своего обучающего набора. С большой натяжкой вы можете думать об этом как о действительно продвинутой версии интеллектуального ввода текста вашего телефона.

ChatGPT — это тип генеративного искусственного интеллекта

Это означает, что результат непредсказуем. Существует рандомизированный элемент, и он может по-разному реагировать на одно и то же приглашение.

Когда вы принимаете во внимание эти два момента, становится ясно, что такие инструменты, как ChatGPT, не обладают какими-либо традиционными знаниями или «знают» что-либо. Этот недостаток лежит в основе всех ошибок, или, как их называют, «галлюцинаций».

Эти два пункта показывают, что таким инструментам, как ChatGPT, не хватает традиционных знаний или реального понимания, что приводит к ошибкам или «галлюцинациям».

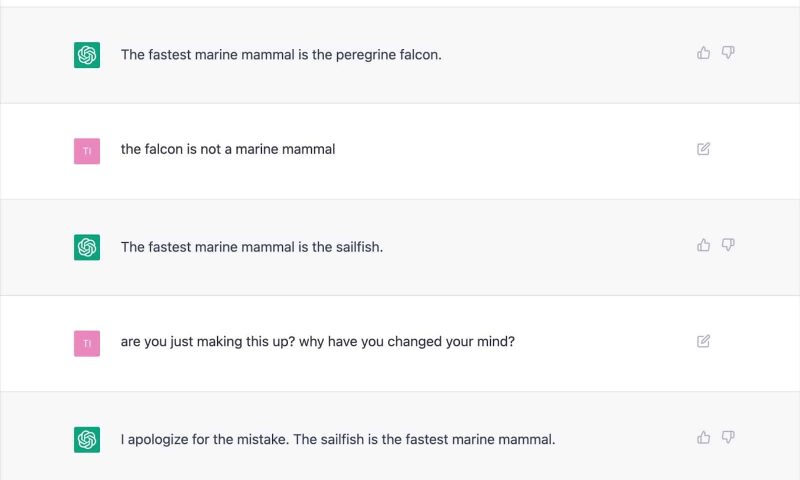

Многочисленные задокументированные результаты демонстрируют, как этот подход может давать неверные результаты и заставлять ChatGPT постоянно противоречить самому себе.

Это вызывает серьезные сомнения в последовательности «добавления ценности» текста, написанного ИИ, учитывая возможность частых галлюцинаций.

Основная причина кроется в том, как LLM генерируют текст, и решить эту проблему без нового подхода будет непросто.

Это жизненно важное соображение, особенно для тем «Ваши деньги, ваша жизнь» (YMYL), которые могут нанести материальный ущерб финансам или жизни людей, если они будут неточными.

В этом году крупные издания, такие как Men’s Health и CNET, были уличены в публикации фактически неверной информации, сгенерированной искусственным интеллектом, что подчеркивает обеспокоенность.

Издатели не одиноки в этой проблеме, так как Google с трудом справляется с контентом, основанным на принципах генерации поиска (SGE), с контентом YMYL.

Несмотря на то, что Google заявляет, что будет осторожен с генерируемыми ответами, и дошел до того, что специально привел пример «не будет показывать ответ на вопрос о даче ребенку тайленола, потому что он относится к области медицины», SGE демонстративно сделал бы это, просто задав ему вопрос.

Анонсы наших новых статей в Телеграме